Navigere i AI-styring og -sikring: Argumenter for ISO/IEC 42001 AI Management System-sertifisering

Dette whitepaperet beskriver behovet for og hvordan organisasjonen din kan utvikle, styre og kontinuerlig overholde både interne og eksterne krav for å fremme vellykket implementering av AI i prosesser, produkter og tjenester.

Kunstig intelligens (AI) er i ferd med å forandre verden, og skape nye muligheter og utfordringer for bedrifter og samfunnet som helhet. Med fremveksten av generativ AI som ChatGPT og Copilot har eksperimenteringen med,og den første bruken av, AI i organisasjoner eksplodert. Vellykkede implementeringer viser at AI kan bidra til effektivitet, kvalitet, innovasjon og kundetilfredshet. Men all ny teknologi har sine risikoer. AI er full av potensielle utfordringer og usikkerhetsmomente,r som må håndteres og reduseres for å sikre trygg, pålitelig og etisk utvikling, anvendelse og bruk.

Her spiller et AI-styringssystem (AIMS) basert på ISO/IEC 42001-standarden en avgjørende rolle for at organisasjoner skal kunne styre sin AI-reise. En strukturert tilnærming tvinger deg til å "tenke før du handler", og kontinuerlig vurdere ytelse og resultater. Denne grunnleggende standarden for AI-styring, risikostyring og tredjepartssertifisering er allerede anerkjent som en grunnpilar for å styre utviklingen og levere pålitelige AI-løsninger.

Dette whitepaperet beskriverhvordan organisasjonen din kan utvikle, styre og kontinuerlig overholde både interne og eksterne krav for å fremme vellykket implementering av AI i prosesser, produkter og tjenester.

Behovet for trygg og ansvarlig bruk av kunstig intelligens

Behovet for pålitelig kunstig intelligens er drevet frem av den økende eksperimenteringen med og innføringen av de mange bruksområdene, interessentenes økende bevissthet og forventninger, samt et etisk og regulatorisk landskap i stadig utvikling. Organisasjoner kan derfor ikke dra nytte av fordelene med kunstig intelligens med mindre det bygges bro over tillitsgapet mellom utviklerne og brukerne av kunstig intelligens. Tillitsgapet refererer til den potensielle mangelen på tillit og åpenhet rundt organisasjonens AI-aktiverte produkter og/eller tjenester. Når det for eksempel er uklart for brukerne hvordan AI-systemer tar beslutninger, fører dette til usikkerhet og skepsis rundt sikkerhet, etiske hensyn, personvern og generell troverdighet. For å si det enkelt: Tilliten vår til en teknologi er avhengig av at vi fullt ut forstår hvordan den brukes, og at vi kan være sikre på at den er trygg og pålitelig.

Å bygge bro over dette tillitsgapet er avgjørende for å kommersialisere og skalere AI-produkter og -tjenester. Det krever at du sørger for en trygg, ansvarlig, pålitelig og etisk implementering av AI. I tillegg må både interne interessenter, som ansatte og toppledelsen, og eksterne interessenter, som kunder og aksjonærer, forsikres om dette.

For å oppnå og vise at løsningene dine er pålitelige, kreves det en systematisk tilnærming som dekker hele livssyklusen for kunstig intelligens. Det strekker seg fra interessentanalyse, riktige beskyttelsestiltak (som etiske retningslinjer), prioritering av brukstilfeller og risikoidentifisering, helt frem til implementering av relevante kontroller. Når vi zoomer inn på tillitsgapet, kan vi identifisere klare behov og forventninger.

For eksempel bør organisasjonen din:

- identifisere og prioritere områder og bruksområder der AI kan tilføre verdi og skape effekt, og forstå fordelene og risikoene

- etablere og opprettholde en kultur preget av tillit, åpenhet og ansvarlighet i organisasjonen

- vurdere og måle ytelsen og kvaliteten til AI-systemer, og sikre at de er i tråd med prinsippene for pålitelighet, eksisterende eller kommende lovgivning og kundekrav

- organisere roller og ansvarsområder i organisasjoner, noe som er spesielt viktig i et teknologidomene som fortsetter å utvikle seg

- vedta og implementere prosesser basert på standarder for beste praksis (f.eks. ISO/IEC 42001) for utvikling, implementering og styring av kunstig intelligens

- kommunisere påliteligheten til AI-systemene til interessenter, og fremlegge bevis og forsikringer om at de er i samsvar med beste praksis, lover og forskrifter

Dette er ikke uttømmende, men det er en oversikt over sentrale behov og forventninger. Ledelsessystemstandarden for kunstig intelligens, ISO/IEC 42001, er utformet for å gi veiledning og struktur som gjør det mulig å navigere effektivt i disse.

Standardiseringens rolle i styringen av AI

All ny teknologi er forbundet med risiko. Det stadig skiftende landskapet med kunstig intelligens, kombinert med det enorme potensialet for anvendelse på tvers av bransjer, forsterker dette ytterligere. Det er for eksempel umulig å forutsi alle utfall i designfasen.

Det er i denne sammenhengen at standarder for styringssystemer, som ISO/IEC 42001, blir spesielt viktige. Når det er behov for offentlig tillit, spiller standardisering og sertifisering en sentral rolle. I tillegg til juridiske, regulatoriske og etiske hensyn er standardisering et middel for å muliggjøre skalerbarhet, bygge inn sikkerhet og veilede organisasjoner inn i det ukjente territoriet som AI for øyeblikket er.

Standarder etablerer viktig terminologi, fremmer bransjestyrte normer, og fanger opp beste praksis for vurdering og forbedring. Standarder for håndtering av kunstig intelligens bidrar til klarhet og ansvarlighet, noe som i stor grad vil bidra til økt aksept i samfunnet. De danner grunnlaget for etterlevelse av regelverk og bransjeadopsjon, og bidrar til at AIs globale potensial kan utnyttes på en trygg, ansvarlig og etisk måte. Dette samtidig som de sikrer nødvendig åpenhet, tillit og sikkerhet blant brukere og andre interessenter.

Rollen til AI-styringssystemer

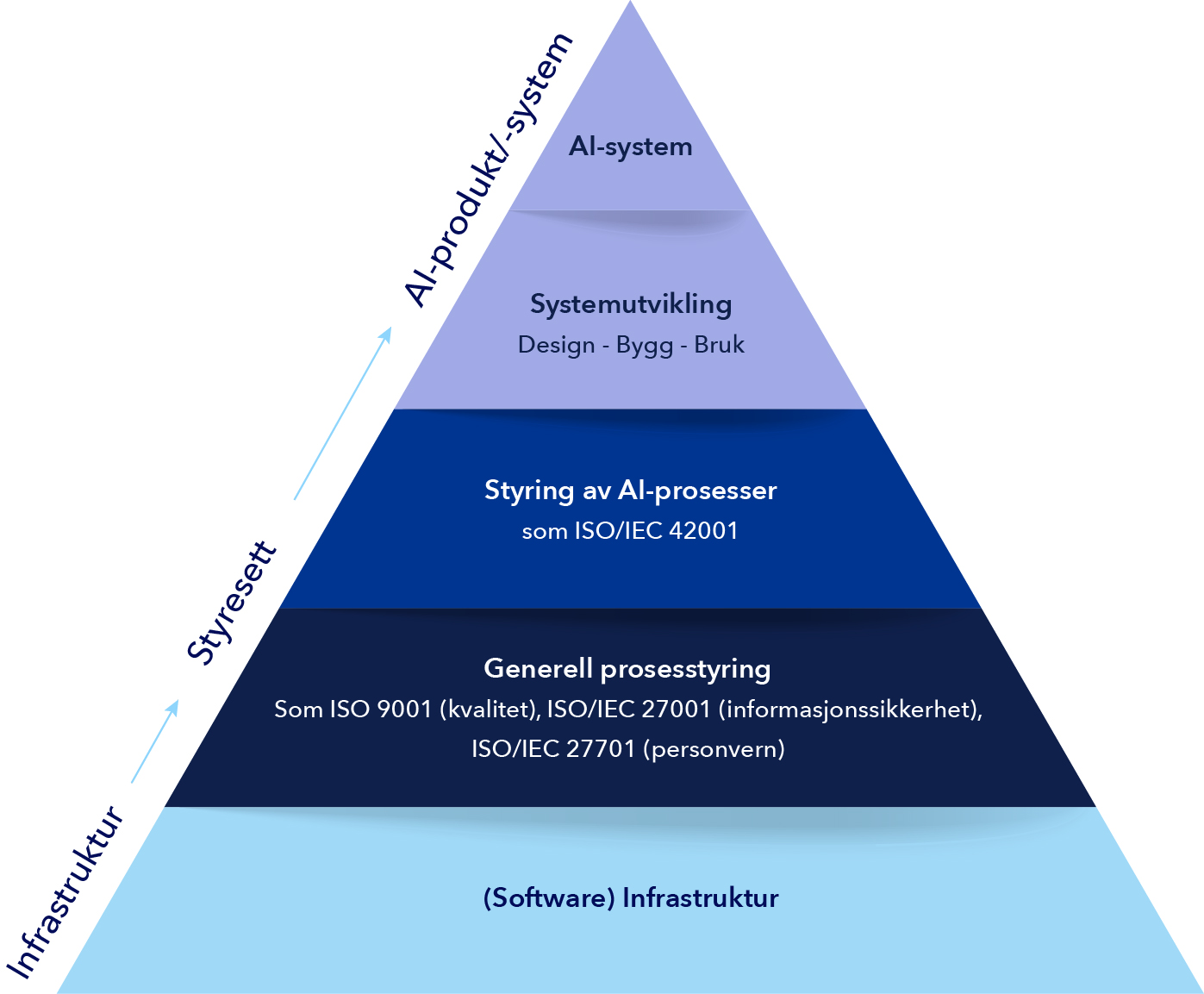

Standarder for styringssystemer og sertifisering kan fungere som et solid grunnlag for organisasjoner når de skal bygge opp styringen rundt kunstig intelligens (se figur 1). Den internasjonale standarden for styringssystemer for kunstig intelligens, ISO/IEC 42001, gir veiledning og stiller krav til organisasjoner som utvikler, distribuerer eller bruker systemer for kunstig intelligens.

Denne etterlengtede standarden ble publisert i slutten av 2023. Den kan brukes på tvers av bransjer og av organisasjoner av alle typer og størrelser, som er involvert i utvikling, levering eller bruk av produkter og/eller tjenester som benytter AI-systemer. Som ISO-standard er den kompatibel med, og utfyller, andre klassiske ISO-standarder for styringssystemer, for eksempel ISO 9001 (kvalitet) og ISO/IEC 27001 (informasjonssikkerhet). ISO/IEC 42001 skaper en balanse mellom å fremme AI-innovasjon og å implementere effektiv styring.

Det betyr at du kan dra nytte av, og bygge videre på, ethvert eksisterende styringssystem og generell prosesstyring. Det sikrer en helhetlig tilnærming til hvordan du gjør AI til en integrert del av produkter, tjenester, eller til og med interne applikasjoner.

I skjemaet nedenfor plasserer vi ISO/IEC 42001 som et prosesstyringsverktøy i "forsikringspyramiden". I pyramidens fundament finner du organisasjonens grunnleggende infrastruktur. Alt som må være på plass for at organisasjonen skal fungere. For å kunne styre og forbedre seg velger mange organisasjoner å implementere ledelsessystemer i samsvar med standarder for kvalitet (ISO 9001), informasjonssikkerhet (ISO/IEC 27001) eller andre ledelsessystemstandarder. Sertifisering er da et middel til å demonstrere samsvar overfor ulike interessenter.

Ettersom ISO/IEC 42001 følger en lignende struktur som de andre ISO-standardene for ledelsessystemer, gjør den det enklere å utfylle ledelsessystemet ditt med kravene til AI-ledelsessystemer. På denne måten danner prosessstyringen grunnlaget for å utforme, bygge og bruke pålitelige AI-systemer.

Hovedmålene med ISO/IEC 42001 er å

- tilby et rammeverk og en metodikk for å etablere, implementere, vedlikeholde og forbedre et styringssystem for kunstig intelligens, som dekker hele livssyklusen.og tar utgangspunkt i en risikobasert tilnærming

- gjøre det mulig å demonstrere og kommunisere påliteligheten til en organisasjons AI-systemer og -prosesser.

- bidra til overholdelse av regelverk og lover, noe som vil bli stadig viktigere i takt med at nasjonale og internasjonale regelverk vokser, slik som det European AI Act som allerede har vært gjeldende siden august 2024

- legge til rette for interoperabilitet og integrering av KI-systemer og -prosesser

- fremme samarbeid og koordinering mellom interessenter

- støtte innovasjon og forbedring av AI-systemer og -prosesser

- oppmuntre til å ta i bruk og spre beste praksis og standarder for håndtering av kunstig intelligens.

Forholdet mellom ISO/IEC 42001 og lover og forskrifter for kunstig intelligens forventes å være synergisk og gjensidig fordelaktig. Selv om EUs AI-lov har et utpreget produktfokus, gir innføringen av et AI-styringssystem et grunnlag for å bygge og levere konsistente og forutsigbare, pålitelige AI-systemer, og standardens kontroller er i tråd med det regelverket krever at man overholder.

Til syvende og sist vil et godt implementert styringssystem, som oppfyller alle relevante standarder, sikre integritet, personvern og etisk bruk av data. Samtidig er det tilpasningsdyktig nok til å integrere stadig skiftende krav fra kunder, teknologiske fremskritt, juridiske og regulatoriske instanser, og så videre.

Veien videre?

For å starte prosessen med å innføre et ISO/IEC 42001-sertifisert ledelsessystem kan du bruke DNVs-artikkel om “8 steg til sertifisering av et ISO/IEC 42001-ledelsessystem”

Et selvevalueringsverktøy følger med, som veiledning. Prosessen starter med en gjennomgang av toppledelsen, for å identifisere de viktigste grunnene til å innføre et AI-styringssystem (AIMS). Deretter bør organisasjonen sette seg inn i ISO/IEC 42001-standarden, og fastsette en strategisk retning som samsvarer med de identifiserte målene.

De følgende trinnene omfatter planlegging og ressursallokering, forståelse og kartlegging av nøkkelprosesser og identifisering av opplæringsbehov for de ansatte. Forberedelse, utvikling og implementering av gjeldende prosesser og prosedyrer er typiske trinn, og det er viktig å gjennomføre interne revisjoner og ledelsens gjennomganger for å kontrollere systemets effektivitet underveis. Ved å bruke DNVs egenevalueringsverktøy kan du identifisere mangler i forhold til standardkravene, og få en målrettet tilnærming til å oppfylle kravene i ISO/IEC 42001.

Hvorfor velge DNV?

Som et verdensledende sertifiseringsorgan har 80 000 selskaper over hele verden valgt DNV, når det gjelder sertifisering av styringssystemer og opplæring. Vi har unik kompetanse, bransjekunnskap og kapasitet ,som er relevant for AI og andre ledelsessystemer.

Når du velger DNV, får du:

- En global aktør innen informasjonssikkerhet og personvern: Vi har lang erfaring med sertifisering og opplæring innen informasjonssikkerhet og personvern, noe som er avgjørende å integrere i AI-styringen din.

- Risikobasert sertifisering™: Vi bruker en proaktiv risikobasert tilnærming til sertifisering, noe som betyr at vi kan hjelpe organisasjoner med å identifisere potensielle risikoer i AI-systemene sine på et tidlig tidspunkt, for å sikre at de håndteres før de blir et problem.

- Lumina™: Dette er vårt datasmarte benchmarking-verktøy, som gir dypere innsikt i og analyser av styringssystemet, helt fra de vanligste feilene og feilrettingene til en fullstendig oversikt over alle selskapets nettsteder, og sammenligninger med sammenlignbare nettsteder.

- Ledelse av opplæring: Digitale løsninger som hjelper bedriften din med å administrere og sikre konsekvent bevisstgjøring og kompetanseutvikling av ansatte i hele organisasjonen.

- Kompetente revisorer med en pragmatisk tilnærming, som lytter til kundens behov, samtidig som de sørger for at samsvar med standarden blir vurdert.

- Prosesser for kundeadministrasjon, som er strukturert for å levere en overlegen kundeopplevelse.

DNV har forpliktet seg til å levere pålitelige og verdiskapende tjenester innen AI-sikring. Med utgangspunkt i vår uavhengighet, vår rolle som tredjepart, og vårt prinsipp om ikke å gå på akkord med kvalitet og integritet, samarbeider vi med kunder for å hjelpe dem med å navigere trygt gjennom kompleksiteten i AI og de relaterte utfordringene. På den måten vil vi sikre nødvendig styring for å levere AI-systemer som er klarerte for å være trygge, pålitelige og sikre.